Hace muy pocos días pasó algo que llevo semanas esperando. Jensen Huang, el CEO de NVIDIA, se subió al escenario del GTC 2026 en San José con su chaqueta de cuero de siempre… y durante casi tres horas nos dejó a todos con la boca abierta.

No exagero.

Lo que se anunció en este evento no es una simple actualización de producto. Es de esas cosas que miras y piensas “vale, el mundo acaba de cambiar un poco”. Y creo que mucha gente todavía no se ha dado cuenta.

Vamos a desgranar todo lo que se anunció. Es denso, aviso. Pero merece la pena.

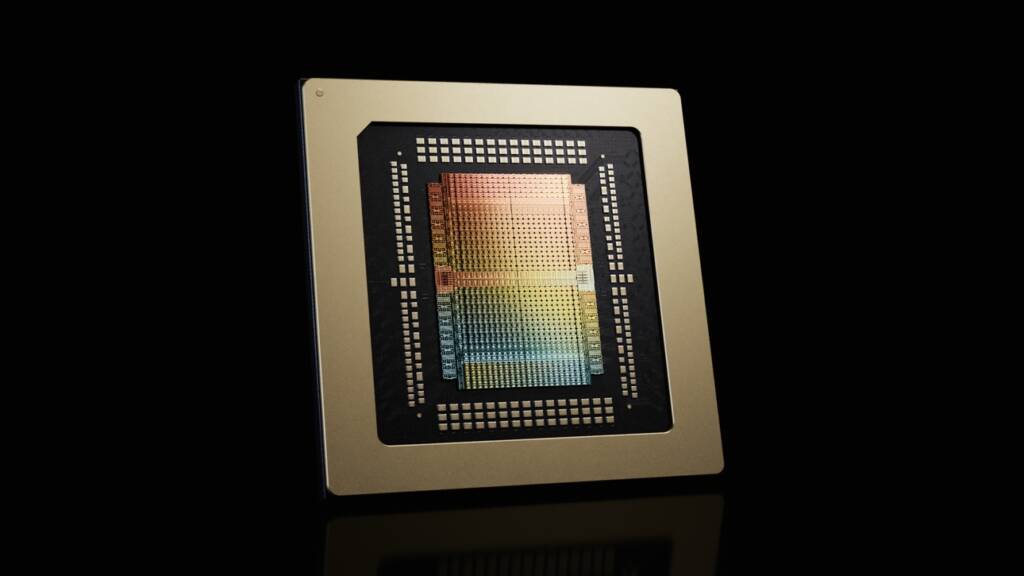

Vera Rubin: la bestia que sustituye a Blackwell

Empecemos por lo gordo.

NVIDIA ha presentado oficialmente la arquitectura Vera Rubin, la sucesora de Blackwell. Y los números son… bueno, juzgad vosotros.

336.000 millones de transistores por GPU. Trescientos treinta y seis mil millones. Blackwell tenía 208.000 millones, así que estamos hablando de un salto del 60% en una sola generación. Fabricado en el proceso de 3 nanómetros de TSMC, nodo completo de diferencia.

Pero lo que a mí me dejó pensando fue otra cosa. El rendimiento de inferencia: 50 petaflops en NVFP4.

Cinco veces más que Blackwell.

Déjame repetirlo porque creo que no se dimensiona bien: cinco veces. En una generación. Hay gente que lleva años esperando mejoras del 20-30% y aquí te plantan un 5x como si nada.

Cada GPU trae 288 GB de memoria HBM4 con un ancho de banda de 22 terabytes por segundo. Y la CPU que la acompaña, que se llama Vera a secas, lleva 88 núcleos ARM y su único trabajo es mantener el cluster de GPUs al máximo las 24 horas. Ni más, ni menos. Una CPU al servicio de las GPUs.

El sistema completo, el Vera Rubin NVL72, empaqueta 72 de estas GPUs en un solo rack. Lo que NVIDIA dice —y aquí ya cada uno que juzgue hasta qué punto se lo cree— es que esto reducirá el coste por token de inferencia hasta en 10 veces.

¿Cuándo llega? Segunda mitad de 2026. AWS, Google Cloud, Azure y Oracle ya están en la lista.

La compra de Groq: 20.000 millones por la velocidad

Y aquí viene uno de los movimientos más audaces que he visto en tech en mucho tiempo.

NVIDIA compró Groq en diciembre de 2025 por 20.000 millones de dólares. Para quien no la conozca: Groq había revolucionado la inferencia con su LPU, una arquitectura basada en SRAM capaz de generar texto a velocidades que parecían de ciencia ficción. Velocidades que hacían que te preguntaras si tu conexión a internet había mutado.

Pues bien. Huang presentó el Groq 3, el primer chip nacido de esa adquisición. Un rack LPX con 256 LPUs diseñado para sentarse al lado del Vera Rubin y encargarse de la inferencia en tiempo real para agentes de IA.

El dato que me dejó clavado: ese rack puede multiplicar por 35 veces el rendimiento de tokens por vatio respecto a las GPUs Rubin solas. 35x. Y el objetivo de velocidad es de 1.500 tokens por segundo para comunicaciones entre agentes.

Básicamente, NVIDIA ha partido el mundo de la IA en dos mitades: entrenamiento (Vera Rubin) e inferencia ultrarrápida (Groq). Es como tener un cerebro para pensar y otro para hablar. Cada uno hace lo que mejor sabe hacer.

La pregunta que me hago es si esto no acaba convirtiendo a NVIDIA en algo demasiado grande. Demasiado imprescindible. Pero de eso hablo más abajo.

Un billón de dólares. Con B.

Hay un dato que sobrevuela toda la keynote y que lo cambia todo.

Jensen Huang dijo, con esa calma suya que a veces da un poco de miedo, que espera que los pedidos combinados de Blackwell y Vera Rubin alcancen un billón de dólares hasta 2027. Un trillion en inglés, para que no haya confusión.

Un billón.

Los ingresos de NVIDIA por data centers en el año fiscal 2026 ya fueron de 193.500 millones. Que ya es una cifra que cuesta procesar. Pero un billón en pedidos es directamente otra galaxia.

Y eso te dice algo que a veces se nos olvida: la demanda de computación de IA no está bajando. No se está moderando. Está acelerando. Gobiernos, big tech, startups, empresas de todos los sectores… todo el mundo quiere más GPUs. Y NVIDIA es, de momento, la única que puede servir a esa escala.

El momento ChatGPT del coche autónomo

Huang lo dijo así, literalmente: “El momento ChatGPT de la conducción autónoma ha llegado.”

Frase grande. Ya veremos.

Lo concreto: expansión masiva de la plataforma DRIVE Hyperion 10 para vehículos autónomos de nivel 4. Los nuevos socios son BYD, Hyundai, Nissan y Geely, que entre todos venden una barbaridad de coches.

Pero lo que me llamó la atención de verdad fue la alianza con Uber. Servicios de robotaxi totalmente autónomos en Los Ángeles y San Francisco para la primera mitad de 2027. Y el plan es expandirse a 28 ciudades en todo el mundo para 2028.

Veintiocho ciudades. En dos años.

No sé si eso es exactamente así o hay algo de bombo, porque las promesas de conducción autónoma llevan años siendo… optimistas, digamos. Pero si NVIDIA pone su infraestructura detrás y Uber pone su red de distribución, tiene más pinta de funcionar que otros intentos anteriores. Al menos sobre el papel.

NemoClaw: el sistema operativo de los agentes de IA

Otro anuncio que pasó un poco desapercibido entre tanto hardware pero que creo que va a ser enorme.

Primero, el contexto. OpenClaw se ha convertido en el proyecto de código abierto de mayor crecimiento en la historia. Es básicamente un framework para crear y ejecutar agentes de IA localmente, en tu propio hardware. Sin depender de la nube de nadie. Si leísteis mi artículo sobre Moltbook, ya sabéis de qué va esto y las vulnerabilidades que trae consigo.

NVIDIA ha construido NemoClaw encima de OpenClaw: una plataforma empresarial para ejecutar estos agentes de forma segura en las nuevas estaciones de trabajo RTX PRO 6000, que tienen hasta 4.000 TOPS de computación de IA local y 96 GB de memoria GPU.

Además, Huang anunció la Nemotron Coalition, una alianza con Perplexity, Mistral AI, LangChain y otros para desarrollar modelos de frontera abiertos. Es la respuesta de NVIDIA al ecosistema cerrado de OpenAI: modelos abiertos, ejecutados localmente, con hardware de NVIDIA.

Para mí, este es el anuncio que más impacto va a tener a medio plazo. Poder ejecutar agentes de IA potentes en tu propia máquina sin enviar tus datos a ningún servidor externo… eso le quita la excusa a muchas empresas que hoy no usan IA por temas de privacidad. Bueno, al menos en teoría. Luego la implementación es otro cantar, como siempre.

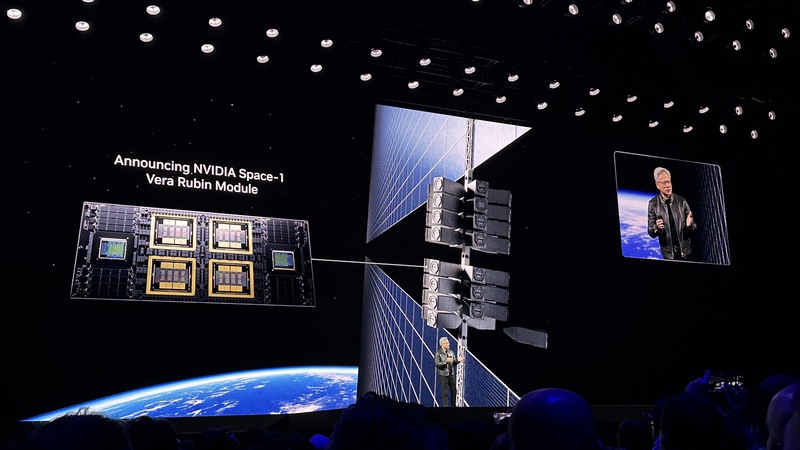

Data centers en el espacio. Sí, en el espacio.

Y cuando pensabas que ya lo habías visto todo, Huang saca esto.

NVIDIA presentó el Vera Rubin Space-1. Un módulo de computación diseñado específicamente para operar en órbita. Data centers orbitales. Lo leo y todavía me cuesta un poco.

El módulo combina dos GPUs Rubin con una CPU Vera en una arquitectura que ofrece hasta 25 veces más computación de IA que el H100, adaptada para las condiciones del espacio: radiación, temperaturas extremas, vibración… Los partners que ya están trabajando en esto incluyen a Aetherflux, Axiom Space, Planet Labs y Kepler Communications. La idea es procesar datos de satélites y sensores directamente en órbita.

Suena a ciencia ficción, lo sé. Pero cuando NVIDIA anuncia algo con partners y fechas concretas, suele ir en serio. ¿Cuándo veremos data centers funcionando en órbita? Esa es otra pregunta. Sinceramente, me da un poco de vértigo pensarlo.

Recuerda que traté sobre este tipo de despliegues en órbita en mi post “Centros de datos en órbita: ¿la nube definitiva para la era de la IA?” De hecho, los renders que Nvidia usó en la presentación de este punto eran de StarCloud.

DLSS 5: cuando la IA pinta los píxeles

Para los que además de profesionales somos gamers —que somos muchos más de los que la gente cree—, NVIDIA presentó DLSS 5.

No es un upscaler como las versiones anteriores. Es un modelo de renderizado neuronal en tiempo real que genera iluminación y materiales fotorrealistas a partir de IA. La IA literalmente pintando los píxeles con información sobre cómo funciona la luz en el mundo real. Digital Foundry, que no suele regalar elogios, dijo que es lo más asombroso que han visto en mucho tiempo.

Llegará en otoño de 2026.

¿Y qué hay después de Vera Rubin?

Pues resulta que NVIDIA ya tiene respuesta. Se llama Kyber.

Huang mostró un prototipo de la arquitectura siguiente: 144 GPUs organizadas en bandejas verticales —no horizontales como hasta ahora— para aumentar la densidad y reducir la latencia. Se llama Vera Rubin Ultra y llegará en 2027.

Ya están trabajando en la generación siguiente a la que acaban de anunciar. Esa es la velocidad a la que se mueve esto. Y la velocidad a la que te tienes que mover tú si no quieres quedarte fuera.

El GTC 2026 va a ser recordado como uno de los eventos más importantes en la historia reciente de la tecnología. Y no es por un solo anuncio, es por todo junto. NVIDIA ya no es una empresa de tarjetas gráficas. Eso ya lo sabíamos. Pero es que ahora está construyendo la infraestructura sobre la que va a correr toda la IA del planeta. Incluida la que va a funcionar fuera de él, en órbita.

Con un billón en pedidos previstos y la compra de Groq por 20.000 millones, Huang está jugando a un nivel que pocos CEOs han alcanzado. Eso es innegable.

¿Riesgos? Los hay, claro. Que el mundo dependa tanto de una sola empresa para toda la computación IA me preocupa. AMD, Intel, los chips propios de Google y Amazon… la competencia existe pero va por detrás. Y las valoraciones son tan altas que cualquier tropiezo va a doler.

Pero ahora mismo, si me preguntas quién marca el ritmo… no tengo dudas.

¿Qué os parece? ¿Creéis que NVIDIA puede mantener este ritmo o estamos ante una burbuja que va a explotar más pronto que tarde? Me encantaría leer vuestras opiniones.

¡Buena semana!

Fuentes del artículo:

- CNBC — “Nvidia GTC 2026: CEO Jensen Huang sees $1 trillion in orders for Blackwell and Vera Rubin through ’27” (16 mar 2026)

- Tom’s Hardware — “Nvidia GTC 2026 keynote live blog — Vera Rubin GPUs and CPUs, DLSS 5” (16 mar 2026)

- TweakTown — “NVIDIA unveils Vera Rubin at GTC 2026” (16 mar 2026)

- StorageReview — “NVIDIA GTC 2026: Rubin GPUs, Groq LPUs, Vera CPUs” (16 mar 2026)

- Techzine — “Nvidia’s Groq 3 LPU targets agentic AI inference at GTC 2026” (16 mar 2026)

- NVIDIA Newsroom — “NVIDIA Makes the World Robotaxi-Ready With Uber Partnership” (16 mar 2026)

- Tom’s Hardware — “Nvidia announces Vera Rubin Space Module” (16 mar 2026)

- NVIDIA Newsroom — “NVIDIA Launches Space Computing” (16 mar 2026)

- TechCrunch — “NVIDIA’s DLSS 5 uses generative AI to boost photorealism” (16 mar 2026)

- Tom’s Hardware — “Nvidia’s Nemotron coalition brings eight AI labs together” (16 mar 2026)